Sie haben genug Traffic

für aussagekräftige Experimente

Die meisten Marken mit begrenztem Traffic hören, sie könnten nicht testen. Das ist falsch. Was sie brauchen, ist eine Methodik, die auf kleinere Stichproben kalibriert ist — korrekte MDE-Schwellenwerte, Varianzreduktion und umsatzbasierte Auswertung statt Conversion-Rate-Raterei.

DRIP Agency führt strukturierte A/B-Testing-Programme für E-Commerce-Marken mit begrenztem Traffic durch. Die Annahme, dass Millionen von Sessions nötig sind, ist ein Mythos — verbreitet von Agenturen, die statistische Power nicht verstehen. Entscheidend ist nicht das reine Traffic-Volumen, sondern das Verhältnis zwischen Traffic, dem Minimum Detectable Effect (MDE) und der Varianz Ihrer Primärmetrik. Wir nutzen CUPED-Varianzreduktion, um die benötigte Stichprobengröße zu senken, Revenue per Visitor als Primärmetrik für höhere Sensitivität und sequentielle Testgrenzen, damit jede Session zählt. Über 4.000+ Experimente und 250+ Kundenprojekte hinweg haben wir nachgewiesen, dass Marken mit 30.000–50.000 monatlichen Sessions belastbare Experimente durchführen können — sie brauchen nur die richtige Methodik.

Warum Marken mit wenig Traffic zu früh aufgeben

Das Standard-Playbook für A/B Testing geht von hohem Traffic aus. Stichprobenrechner liefern riesige Zahlen, Agenturen fordern 100.000+ monatliche Sessions, und die Tools sind auf Enterprise-Retailer voreingestellt. Für Marken im Bereich von 20.000–80.000 Sessions lautet die Botschaft: Komm zurück, wenn du größer bist.

Diese Botschaft ist nicht nur demotivierend — sie ist statistisch falsch. Folgendes passiert, wenn Marken mit wenig Traffic ohne methodische Anpassung testen:

- Tests werden auf 2–3 % Conversion-Rate-Effekte ausgelegt, obwohl der Traffic nur 8–12 % Effekte zuverlässig erkennen kann — das Ergebnis: endlose inkonklusive Tests

- Bayesianische Banditen werden eingesetzt, weil sie schnellere Ergebnisse versprechen — sie unterschätzen jedoch systematisch die Unsicherheit und erzeugen falsche Sicherheit

- Tests laufen 7–14 Tage, unabhängig davon, ob die statistische Power erreicht wurde — Rauschen wird als Signal verkauft

- Die Conversion Rate wird als Primärmetrik verwendet, obwohl Revenue per Visitor auf demselben Traffic 2–3x höhere Sensitivität bietet

- Keine Varianzreduktion wird angewendet — die Marke benötigt 30–50 % mehr Traffic als tatsächlich nötig

- Das Team verliert das Vertrauen in Experimentation und kehrt zu meinungsbasierten Design-Entscheidungen zurück

Das Problem ist nicht zu wenig Traffic. Das Problem ist eine Methodik, die für jemand anderen Traffic-Level konzipiert wurde. Das statistische Framework an die eigene Stichprobengröße anzupassen, ist kein Kompromiss — so funktioniert rigorose Experimentation.

Wie DRIP bei wenig Traffic testet

Unsere Low-Traffic-Methodik basiert auf denselben frequentistischen Grundlagen wie unsere High-Traffic-Programme. Der Unterschied liegt in der Kalibrierung: Wir passen MDE-Erwartungen, Metrik-Auswahl und Varianzreduktionstechniken an, um aus jeder Session maximale Erkenntnisse zu gewinnen.

1. Traffic- & MDE-Assessment

Vor dem ersten Test führen wir eine Power-Analyse auf Ihren realen Traffic-Daten durch. Diese zeigt den Minimum Detectable Effect, den Ihre Website bei 95 % Konfidenz und 80 % Power zuverlässig messen kann. Für Marken mit 30.000–60.000 monatlichen Sessions bedeutet das typischerweise Effekte von 5–12 % statt der 2–3 %, die High-Traffic-Programme anstreben. Das ist keine Einschränkung — es ist eine Kalibrierung. Große Effekte sind dort, wo der Umsatz steckt, und genau das liefern gut recherchierte Hypothesen.

2. Priorisierung von High-Impact-Seiten

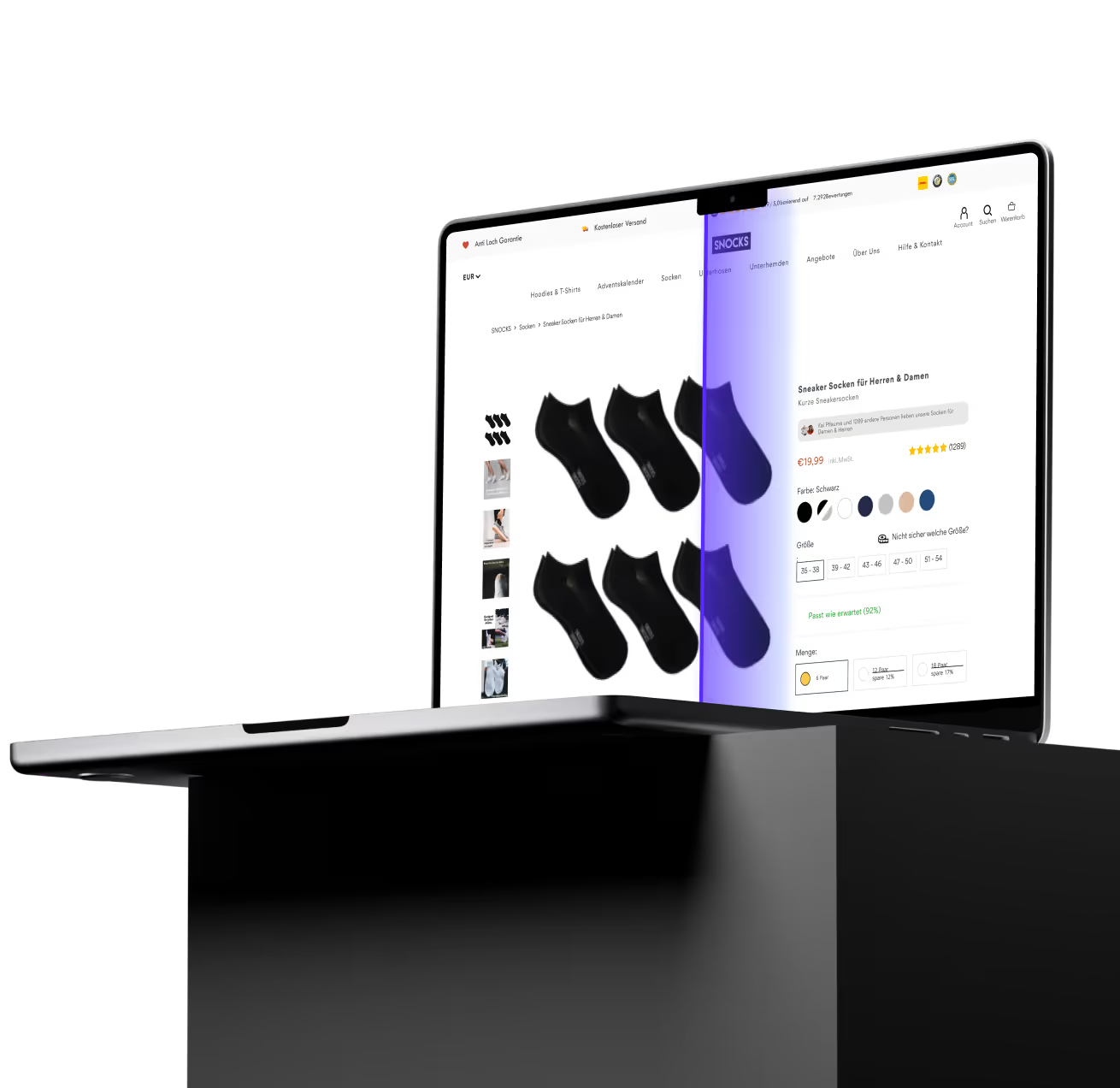

Bei begrenztem Traffic können Sie es sich nicht leisten, ihn auf Tests mit geringem Impact zu verschwenden. Wir priorisieren Seiten und Elemente mit der höchsten Umsatzkonzentration: Produktdetailseiten, Warenkorb, Checkout und Kategorieseiten, wo die Conversion-Intention am stärksten ist. Unser Priorisierungsframework kombiniert Traffic-Volumen, Revenue per Session und erwartete Effektgröße, um Chancen nach statistischer Machbarkeit zu bewerten — nicht nur nach Bauchgefühl.

3. Varianzreduziertes Testing (CUPED)

CUPED (Controlled-experiment Using Pre-Experiment Data) ist die wirkungsvollste Technik für Low-Traffic-Testing. Durch die Nutzung des Nutzerverhaltens vor dem Experiment als Kovariate reduziert CUPED die Varianz Ihrer Primärmetrik — was die benötigte Stichprobengröße direkt senkt. In der Praxis reduziert CUPED die erforderliche Stichprobe um 20–40 %, sodass ein Test, der 60 Tage Traffic bräuchte, in 40–45 Tagen signifikant wird. Wir wenden CUPED standardmäßig auf Revenue per Visitor an.

4. Umsatzbasiertes Entscheidungsframework

Wir bewerten jedes Experiment anhand von Revenue per Visitor (RPV) statt der Conversion Rate als Primärmetrik. RPV erfasst sowohl Conversion-Wahrscheinlichkeit als auch Bestellwert in einer einzigen Metrik und bietet pro Session eine höhere Sensitivität. Kombiniert mit frequentistischen Hypothesentests, sequentiellem Monitoring mit Alpha-Spending-Funktionen und vordefinierten Stoppregeln liefert dies entscheidungsfähige Ergebnisse ohne statistische Kompromisse. Wir setzen keine Bayesianischen Banditen ein — sie tauschen Rigorosität gegen Geschwindigkeit in einer Weise, die Fehler über ein Testing-Programm hinweg kumuliert.

Dieser Ansatz ist kein Workaround. Es ist die Methodik, die Georgi Georgiev und andere führende Statistiker für Tests bei begrenzten Stichproben empfehlen: MDE-Erwartungen anpassen, Varianz reduzieren, hochsensitive Metriken wählen und Tests ordentlich zu Ende laufen lassen.

Zahlen aus dem Feld

Über 4.000+ Experimente hinweg. Low-Traffic-Sites tendieren zum oberen Bereich, aber CUPED und RPV-Auswahl halten die Laufzeiten handhabbar.

Produktdetailseiten liefern die höchste Gewinnrate in unserem Datensatz — der beste Startpunkt bei begrenztem Traffic.

Checkout-Tests konvertieren mit 31,2 % Gewinnrate bei hohem Umsatz-Impact pro Gewinner — ideal für konzentrierte Traffic-Allokation.

Ergebnisse, die für sich sprechen

KoRo

Blackroll

Weiterführende Ressourcen

CRO License

Full-Stack Conversion-Optimierung mit Psychologie-Research, Testing und Compounding Learning.

A/B Testing Statistiken

Die statistischen Grundlagen valider Experimentation — Stichprobengröße, Power und Signifikanz.

CRO-Statistiken & Benchmarks

Conversion-Rate-Benchmarks, Testing-Benchmarks und Abbruchdaten für europäischen E-Commerce.

Sie haben genug Traffic zum Testen. So geht's.

Buchen Sie ein Strategiegespräch und erfahren Sie, was Ihre Website heute messen kann — und wie CUPED, MDE-Kalibrierung und umsatzbasierte Metriken begrenzten Traffic in ein belastbares Testing-Programm verwandeln.

The Newsletter Read by Employees from Brands like

Häufig gestellte Fragen

Es gibt kein universelles Minimum. Der benötigte Traffic hängt von drei Variablen ab: dem Minimum Detectable Effect (MDE), den Sie messen müssen, der Basisvarianz Ihrer Primärmetrik und dem gewünschten Konfidenzniveau. Als Richtwert: Marken mit 30.000+ monatlichen Sessions auf ihren Conversion-Seiten können typischerweise 6–12 % Effekte auf Revenue per Visitor bei 95 % Konfidenz detektieren. Unter 20.000 Sessions ist Testing möglich, aber auf Hypothesen mit großen Effekten oder längere Laufzeiten beschränkt. Die richtige Antwort liefert eine Power-Analyse auf Ihren realen Daten, keine generische Schwelle.

MDE ist der kleinste wahre Effekt, den Ihr Test bei Ihrem Traffic, Ihrer Metrik-Varianz und dem gewünschten Konfidenzniveau zuverlässig erkennen kann. Bei Low-Traffic-Sites ist der MDE größer — typischerweise 5–12 % statt der 2–3 % bei Enterprise-Retailern. Das ist kein Problem, wenn Ihre Hypothesen auf große Effekte ausgelegt sind — genau das liefert psychologiebasierte Forschung. Die Kernaussage: Ein korrekt kalibrierter MDE sagt Ihnen, welche Tests Sie durchführen sollen, nicht ob Sie testen können.

Bayesianische Methoden und Multi-Armed Bandits werden häufig als Lösung für Low-Traffic-Testing vermarktet, weil sie schnellere Ergebnisse versprechen. Die Realität: Sie erreichen dies, indem sie die Fehlerkontrolle lockern, die frequentistische Methoden gewährleisten. Bayesianische Posterior-Wahrscheinlichkeiten sind nicht äquivalent zu frequentistischen Konfidenzintervallen, und Bandits optimieren auf kurzfristigen Gewinn zulasten des langfristigen Lernens. Für ein strukturiertes Experimentation-Programm — bei dem Sie permanente Design-Entscheidungen auf Basis von Testergebnissen treffen — bieten frequentistische Methoden die Fehlerratengarantien, die zählen. Das ist die Position von Georgi Georgiev und der breiteren Experimentation-Statistik-Community.

Die Testdauer hängt vom Traffic-Volumen, der Metrik-Varianz und dem MDE ab. Bei Sites mit 30.000–60.000 monatlichen Sessions benötigen Tests typischerweise 4–8 Wochen, um statistische Signifikanz auf Revenue per Visitor zu erreichen. Mit CUPED-Varianzreduktion kann dies um 20–40 % sinken. Wir planen immer vollständige Geschäftszyklen ein (mindestens zwei vollständige Wochen), um Wochentag-Effekte zu berücksichtigen. Längere Laufzeiten sind keine Schwäche — sie sind das, was ehrliche Statistik bei kleineren Stichproben erfordert.

CUPED — Controlled-experiment Using Pre-Experiment Data — ist eine Varianzreduktionstechnik, die bei Microsoft entwickelt wurde. Sie nutzt das Nutzerverhalten vor dem Experiment als Kovariate, um die Varianz der Testmetrik zu reduzieren. Geringere Varianz bedeutet kleinere benötigte Stichproben: In der Praxis reduziert CUPED den benötigten Traffic um 20–40 %, abhängig davon, wie prädiktiv das Vorher-Verhalten ist. Für Low-Traffic-Sites ist dies die wirkungsvollste verfügbare Technik. Sie verändert nicht das Testdesign und führt keinen Bias ein — sie lässt Ihren vorhandenen Traffic einfach weiter reichen.

Ja, aber mit sorgfältiger Traffic-Allokation. Bei Low-Traffic-Sites führen wir typischerweise 2–4 Experimente gleichzeitig durch statt der 6–10 auf High-Traffic-Sites. Jeder Test wird nicht-überlappenden Seitengruppen zugewiesen (z. B. einer auf PDP, einer im Warenkorb, einer auf Kategorieseiten), um Interaktionseffekte zu verhindern und gleichzeitig die statistische Power jedes Experiments zu erhalten. Das Ziel ist maximale Lerngeschwindigkeit innerhalb der Traffic-Grenzen — nicht maximale Parallelität um ihrer selbst willen.